江苏省南通市名校联盟2024—2025学年高三模拟演练语文

2026-01-20

6

0

38.4KB

23 页

10玖币

侵权投诉

江苏省南通市名校联盟 2024—2025 学年高三模拟演练

语文试题

注意事项

考生在答题前请认真阅读本注意事项及各题答题要求:

1.本试卷共 8页,满分为 100 分,考试时间为 75 分钟。考试结束后,请将

本试卷和答题卡一并交回。

2.答题前,请务必将自己的姓名、准考证号用 0.5 毫米黑色墨水的签字笔填

写在试卷及答题卡的规定位置。

3.请认真核对监考员在答题卡上所粘贴的条形码上的姓名、准考证号与本人

是否相符。

4.作答选择题,必须用 2B 铅笔将答题卡上对应选项的方框涂满、涂黑;如

需改动,请用橡皮擦干净后,再选涂其他答案。作答非选择题,必须用 0.5

毫米黑色墨水的签字笔在答题卡上的指定位置作答,在其他位置作答一律无

效。

5.如需作图,必须用 2B 铅笔绘、写清楚,线条、符号等须加黑、加粗。

一、现代文阅读(35 分)

(一)现代文阅读Ⅰ(本题共 5小题,19 分)

阅读下面的文字,完成下面小题。

材料一

作为一款 AI 语言模型,ChatGPT 由美国人工智能实验室 OpenAI 于2022 年

11 月底发布,并迅速火遍全球。人们长期苦于那些智能语音助手的傻瓜回答,

这次 ChatGPT 却出乎意料的聪明:它可以用来创作故事、撰写新闻、回答客

观问题、聊天、写代码和查找代码问题等。外媒评论称,ChatGPT 会成为科

技行业的下一个“颠覆者”。

ChatGPT 是自然语言处理中一项引人瞩目的进展,它阅览了互联网上几乎所

有数据,并在超级复杂的模型之下进行深度学习。因为语言是人类智慧、思

维方式的核心体现,所以,自然语言处理被称作“ AI 皇冠上的明珠”。而

ChatGPT 的出色表现,被认为可能是迈向通用型 AI 的一种可行路径——作

为一种底层模型,它再次验证了深度学习中“规模”的意义。

2023 年1月12 日,曾担任微软董事长的比尔·盖茨表示,他不认为 Web3 有

那么重要,也不认为元宇宙本身是革命性的,但是人工智能却是颇具颠覆性

的。当被问及如何看待 ChatGPT 时,他说,“这让我能一窥未来。整个平台

的方法和创新速度都令我印象深刻。”人类世界有许多重复性的、程式化的

语言文字工作,不需要复杂的逻辑思考或决策判断。ChatGPT 具有帮助人们

更流畅、更快速地处理这些工作的潜力,可能会成为微软应用程序的“杀手

锏”。比如,在人们需要请假时,只要打出“写一封请病假的邮件”几个字 ,

Outlook(应用程序,微软电子邮箱)就能把措辞正式的请假申请写好。

(摘编自2023 年1月《中国新闻周刊》)

材料二

以ChatGPT 为代表的生成式人工智能在创造社会福利的同时,也带来了诸多

风险。因此,当务之急是结合我国生成式人工智能发展状况,厘清其应用价

值与潜在风险之间的关系,以便在不影响应用发展的前提下有效化解风险。

生成式人工智能的运行机理主要分为三个阶段,也就是机器学习和人工标记

的准备阶段、运用算法对数据进行处理以求出处理后结果的运算阶段、数据

运算产出成品向社会输出并产生影响的生成阶段。当前,生成式人工智能最

突出的风险就是在准备阶段的数据合规风险、运算阶段的算法偏见风险以及

生成阶段的知识产权风险。

根据我国现行法律要求,数据处理者在处理过程中需采取必要措施以保障数

据安全、网络安全和个人信息安全。生成式人工智能的数据合规风险主要体

现在三个方面。首先是数据来源合规风险。以 ChatGPT 为代表的生成式人工

智能,初始阶段往往要采集大量数据以供训练。基于此,可能会面临如下问

题:一是收集个人信息用户是否同意;二是收集使用已公开的信息是否在

“合理范围”;三是收集的样本受到版权保护,进行训练时可否被认定为

“合理使用”。其次是数据使用合规风险。一方面是数据泄露风险。用户会

将个人信息、商业信息甚至商业机密等传输给 ChatGPT。因此,如何保证这

些数据的安全是一个很大的难题。另一方面是用户行使个人信息删除权比较

困难。虽然OpenAI 的隐私协议中规定了用户对其个人信息享有相关的权利

但是鉴于要求生成式人工智能系统删除数据的复杂特性,开发者能否实现对

个人信息的真实删除,还存在较大的不确定性。最后是数据的准确性风险。

在ChatGPT 训练的早期,被投入到数据中的内容是由开发人员从网络中获得

和选择的,有可能出现因为数据的缺失或错误而致使生成内容不准确。

以“人工标注”为辅助的“机器学习”,通过二者的结合,提高了生成式人

工智能的智能化与精确性。但是,这也使得算法偏见的概率急剧增加。这种

结合方法比传统的机器学习方法更能体现人的主观判断和偏好,这是由于人

们将自己的偏好信息加入到机器学习的模型中,从而增加了人们的偏见,并

且这种偏见很难被追踪和防范。ChatGPT 的算法偏见主要表现为两方面:其

一,由于接收到的数据需要人工标注,因此在理解过程中存在着一定的误差 。

其二,当 ChatGPT 对数据进行加工得出结论后,由于原始结果与大众期望不

一致,需要对之进行修正,但这一过程同样会产生一定程度的算法偏见。

生成式人工智能的兴起,对众多产业提出了新的挑战,而最具冲击之处,在

于生成阶段对知识产权领域所构成的挑战。因为生成式人工智能具有高度的

智能化,所以在运算过程中,与之前的人工智能系统相比,其知识产权的归

属发生了颠覆性的变化。ChatGPT 在处理和分析数据方面远远强于分析式人

工智能,其内容生成过程主要包括内容自动化编纂、智能化修整加工、多模

态转换、创意生成等,直接影响着出版的内容生产模式和内容供应模式。尽

管ChatGPT 的创造者中包含一些自然人的创作因素,但这种由生成式人工智

能所创造的作品能否被赋权,仍然存在争论,并且具体的赋权认定标准研究

还处于空白状态。因此,知识产权风险成为生成式人工智能无法规避的第三

大风险。

(摘编自马羽男《生成式人工智能的风险与治理——以 ChatGPT 为例》)

1.下列对材料相关内容的理解和分析,正确的一项是( )

A.过去智能语音助手回答问题相对简单,ChatGPT 却出乎意料聪明,因此

被一致认为是科技行业的下一个颠覆者。

B.相比于颇具颠覆性的人工智能,Web3 在比尔·盖茨看来并不那么的重要,

元宇宙本身的革命性也值得怀疑。

C.只要厘清生成式人工智能的应用价值与潜在风险间的关系,就能在不影

响其应用发展的前提下有效化解潜在风险。

D.生成式人工智能在初始阶段采集数据时,可能采集到没有经过用户同意

的信息,从而产生数据使用合规风险。

2.根据材料内容,下列说法不正确的一项是( )

A.两则材料都涉及以 ChatGPT 为代表的生成式人工智能,但二者阐述的重

点并不相同。

B.从网络中获得和选择训练数据,是生成式人工智能可能存在数据准确性

风险的原因。

C.要避免生成式人工智能出现算法偏见,需要开发者取消“机器学习”中

的“人工标注”。

D.生成式人工智能存在知识产权风险的原因之一是其生成的作品的赋权认

定标准缺失。

3.下列选项中,不能说明生成式人工智能存在“数据合规风险”的一项是(

)

A.不法行为人通过恶意攻击大规模语言模型,提取出相关训练数据,从而

导致个人隐私或个人敏感信息的大规模泄露。

B.不法分子为了牟取利益,利用生成式人工智能技术进行诈骗,比如利用

AI 换脸冒充熟人,获取信任,骗取钱财。

C.原告使用生成式人工智能创作的“文生视频”遭到被告“洗稿”,而被

告以相关认定标准缺失为由否认有侵权行为。

声明:本站为文档C2C交易模式,即用户上传的文档直接被用户下载,本站只是中间服务平台,本站所有文档下载所得的收益归上传人(含作者)所有。玖贝云文库仅提供信息存储空间,仅对用户上传内容的表现方式做保护处理,对上载内容本身不做任何修改或编辑。若文档所含内容侵犯了您的版权或隐私,请立即通知玖贝云文库,我们立即给予删除!

相关推荐

-

【词汇变形总汇】2025高考词汇变形总汇 - 教师版VIP免费

2024-12-06 6

2024-12-06 6 -

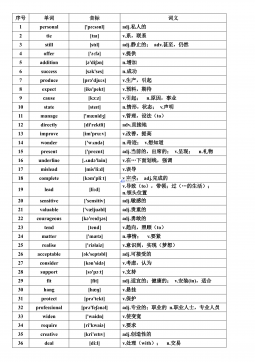

【超简37页】新课标高考英语考纲3500词汇VIP免费

2024-12-06 18

2024-12-06 18 -

《高考英语3500词详解》(WORD版)VIP免费

2024-12-06 33

2024-12-06 33 -

《高考英语3500词详解》VIP免费

2024-12-06 29

2024-12-06 29 -

高中英语-[教师版]80天通关高考3500词汇VIP免费

2024-12-06 33

2024-12-06 33 -

高中人教选修7课文逐句翻译VIP免费

2024-12-06 14

2024-12-06 14 -

高中人教选修7课文原文及翻译VIP免费

2024-12-06 40

2024-12-06 40 -

高中人教必修4课文逐句翻译VIP免费

2024-12-06 31

2024-12-06 31 -

高中人教必修4课文原文及翻译VIP免费

2024-12-06 58

2024-12-06 58 -

高考英语核心高频688词汇VIP免费

2024-12-06 34

2024-12-06 34

分类:中学教育

价格:10玖币

属性:23 页

大小:38.4KB

格式:DOCX

时间:2026-01-20

作者详情

相关内容

-

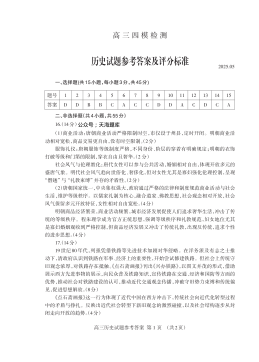

山东省泰安市2025届高三四模检测历史答案

分类:中学教育

时间:2026-03-20

标签:无

格式:PDF

价格:10 玖币

-

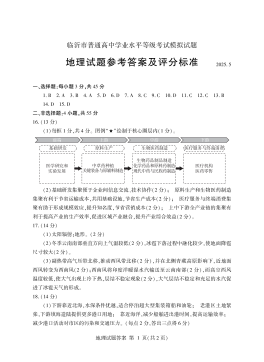

山东省临沂市普通高中学业水平等级考试模拟试题地理答案

分类:中学教育

时间:2026-03-20

标签:无

格式:PDF

价格:10 玖币

-

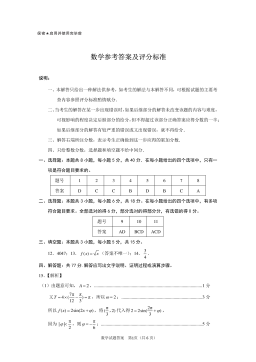

山东省临沂市2025届高三上学期教学质量检测考试暨期中考试(九五联考)数学答案

分类:中学教育

时间:2026-03-20

标签:无

格式:PDF

价格:10 玖币

-

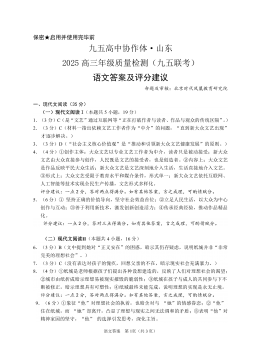

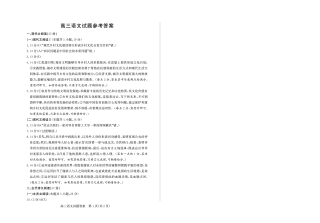

山东省九五高中协作体2025高三年级质量检测(九五联考)语文答案

分类:中学教育

时间:2026-03-20

标签:无

格式:PDF

价格:10 玖币

-

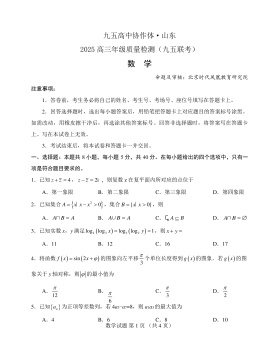

山东省九五高中协作体2025高三年级质量检测(九五联考)数学

分类:中学教育

时间:2026-03-20

标签:无

格式:PDF

价格:10 玖币

渝公网安备50010702506394

渝公网安备50010702506394